AI w pracy w 2026 roku: wielkie obietnice zderzają się z rzeczywistością

Straszono nas wielokrotnie, że już za chwilę, już za momencik systemy sztucznej inteligencji przeorają rynek pracy. AI już dziś jest szeroko stosowane w wielu branżach. Ale czy na pewno jest takim przełomem, jaki przepowiadano?

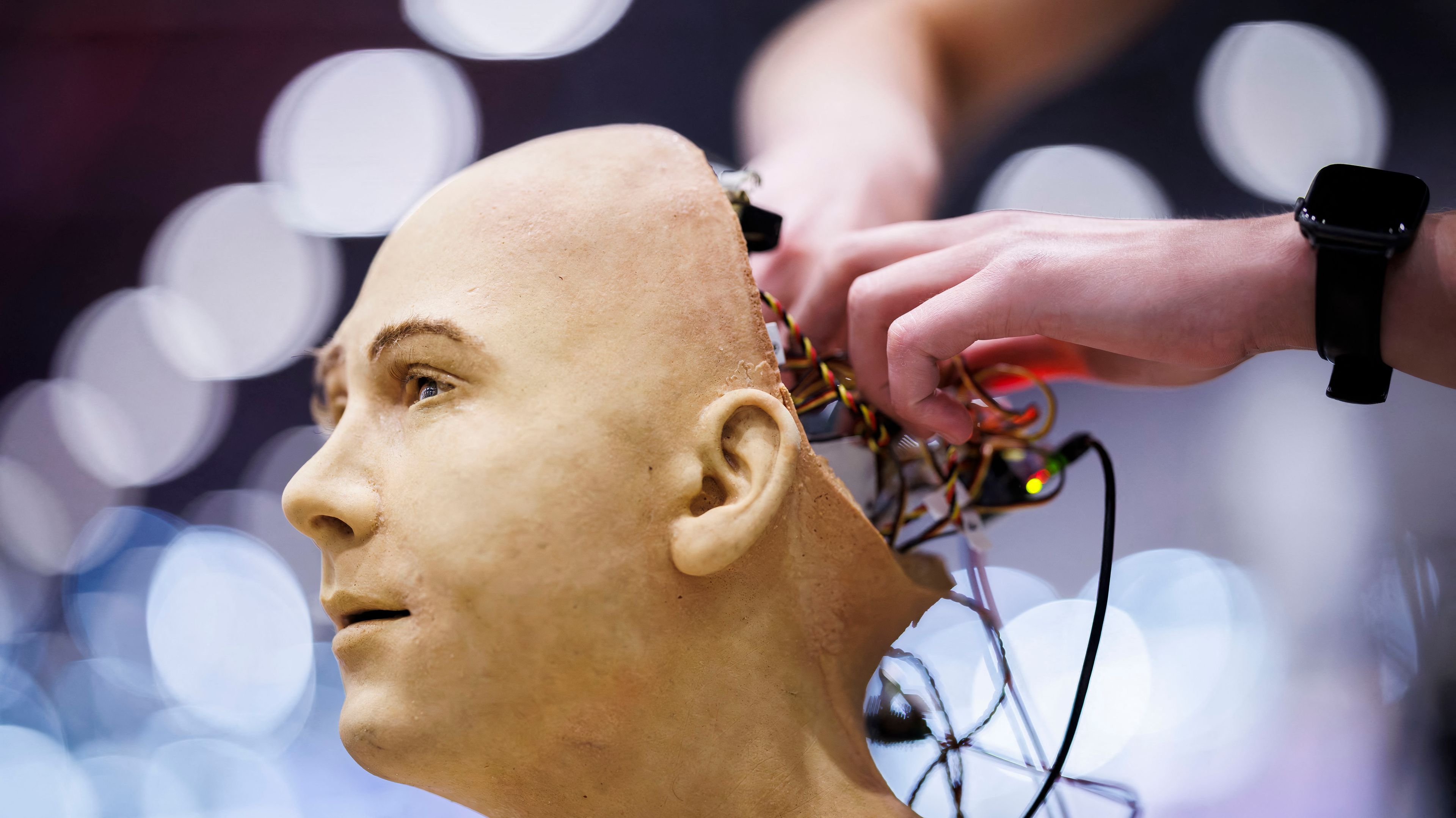

Zanim doczekaliśmy się pęknięcia bańki na generatywną AI, wyobraźnią inwestorów zawładnęła już wizja automatyzacji niemal wszystkiego za pomocą agentów AI. W sektorze technologicznym nie rozmawiamy już o chat botach, które piszą wiersze, generują maile czy przerabiają zdjęcia. Rozmawiamy o systemach, które mają autonomicznie zarządzać naszymi finansami, pracą i czasem. Obietnica jest kusząca: technologia, która pod naszą (mentalną) nieobecność „załatwia sprawunki”.

W praktyce agenty (to kontrintuicyjne pojęcie, ale tak stosuje się je w informatyce) działają jako warstwa pośrednicząca między naszymi komputerami i smartfonami a innymi usługami online.

Agenty AI działają jak cyfrowi zarządcy, którzy już teraz na bieżąco tworzą lub wykorzystują istniejące programy do wykonywania zadań. W praktyce te wciąż eksperymentalne systemy podejmują tysiące mikrodecyzji poza naszą kontrolą. W zależności od poziomu precyzji i cyberbezpieczeństwa takie narzędzia mogą być albo błogosławieństwem, albo szybką ścieżką do finansowej i prawnej katastrofy. Te eksperymentalne struktury to kolejna warstwa pośrednictwa, która oddala użytkownika od sprawczości na rzecz „czarnych skrzynek”.

Metafora czarnej skrzynki pasuje także do stanu dyskusji o wpływie AI na gospodarkę i rynek pracy. Widzimy postęp technologiczny oraz jego – dość mizerne – efekty. Nie umiemy jednak wytłumaczyć, co dzieje się pod powierzchnią. Jakkolwiek źle to nie zabrzmi, w rzeczowej dyskusji można bronić skrajnie odmiennych stanowisk. „AI eliminuje kolejne profesje i już niedługo wyeliminuje większość miejsc pracy wykonywanych za pomocą komputera” oraz „Obecne AI to technologiczna moda, której efektów nie widać w realnym świecie” funkcjonują równolegle.

Przyjrzyjmy się najważniejszym argumentom, które prowadzą do tego paradoksu.

Fetysz wzrostu, który nie nadszedł

Autorzy raportu „Global Intelligence Crisis” alarmują, że już za kilkanaście miesięcy światowa gospodarka będzie nie do poznania. Autorzy prognozują, że do 2028 roku nastąpi gwałtowna deflacja kosztów pracy umysłowej wynikająca z nadpodaży taniej inteligencji algorytmicznej. Według Citrini Research nasycenie rynku usług kognitywnych przez AI doprowadzi do załamania obecnych modeli wyceny kompetencji ludzi. Inteligencja staje się niemal darmowym towarem masowym, co w krótkim terminie generuje potężny szok podażowy dla całej światowej gospodarki, a państwa zmusi do radykalnej przebudowy systemów socjalnych

Ta narracja okazała się tak przekonująca, że przypisuje się jej (krótkotrwały) spadek wartości firm z amerykańskiej listy S&P 500. Problem w tym, że przy głębszej analizie raport sprawia wrażenie typowego „syntetycznego szlamu” (AI slop) generowanego przez czatboty.

Miliardy dolarów wpompowane w infrastrukturę AI w latach 2024-2025 powinny przynieść eksplozję produktywności. Sęk w tym, że dane tego nie potwierdzają. Realny wpływ sztucznej inteligencji na wzrost PKB okazuje się mirażem. Według analiz przytaczanych przez Washington Post, mimo ogromnych nakładów, wkład technologii w dynamikę gospodarki USA pozostaje bliski zeru.

Kapitał przepłynął od inwestorów do producentów sprzętu (czipów, pamięci RAM, urządzeń do budowy centrów danych) oraz korporacji oferujących rozwiązania chmurowe. Realna gospodarka, która miała być przecież beneficjentem tych innowacji, ledwo drgnęła.

Inwestujemy w systemy umiejące imitować ludzką inteligencję, ale systemowo przynosi to korzyści niemal wyłącznie posiadaczom akcji wąskiej grupy gigantów IT. Wdrożenia w tradycyjnych przedsiębiorstwach rozbijają się o brak realnej użyteczności. Zamiast redukcji kosztów, firmy generują nowe potrzeby po stronie dostawców technologii.

Przeczytaj także:

Inżynieria wygrywa z szumem

W tym miejscu trzeba postawić ważne rozróżnienie między rewolucją technologiczną w informatyce i inżynierii a entuzjastyczną marketingową mową-trawą. Automatyzacja ma sens tam, gdzie optymalizuje fizyczne zasoby.

Są takie branże, gdzie te zjawiska działają tu i teraz. Systemy oparte na agentach AI w 2026 roku realnie pomagają w sektorze energetycznym. Pozwalają na dynamiczne bilansowanie sieci przesyłowej, co jest kluczowe przy integracji rozproszonych źródeł odnawialnych czy zarządzaniu magazynami energii. Albo zwiększenie skuteczności kontroli skarbowych czy audytów finansowych skupiając pracę specjalistów tam, gdzie faktycznie należy interweniować.

Podobnie sprawy mają się w programowaniu: automatyzacja testów i zarządzanie długiem technologicznym już dziś przynosi policzalne zyski. W sektorach takich jak gry, rozrywka czy badania pozwala to na zwielokrotnienie zakresu i intensywności pracy bez niepożądanego ryzyka w postaci kosztownych dla innych awarii.

Inaczej jest w obszarach wrażliwych, takich jak np. sektory związane z cyberbezpieczeństwem czy medycyną. Tam skuteczność wprowadzania AI ciągle wymaga zachowania ludzkiego know-how, które pozwala zachować kontrolę nad procesem. Niedawna głośna awaria usług sieciowych Amazona pokazała kruchość scentralizowanych, niesterownych systemów. Początkowo dziennikarze pisali o błędzie spowodowanym puszczeniem modeli AI samopas, ale Amazon oficjalnie wskazał na błąd w rutynowej aktualizacji.

Niezależnie od przyczyny, trend „vibecodingu” – zastępowania rygoru inżynieryjnego przez automatycznie generowany kod bez nadzoru – w wielu obszarach pozostaje ryzykiem systemowym.

Eliminacja „różowych kołnierzyków” i cyfrowych poddostawców

Sprawa faktycznego wpływu AI na gospodarkę i miejsca pracy jest ważna, bo może spowodować poważne „skutki uboczne”. Dane NASK i ILO z czerwca 2025 roku pokazują brutalną prawdę o polskim rynku pracy. 30,3 proc. miejsc pracy wykazuje wysoką podatność na automatyzację. To ponad 5 mln osób.

Według raportu Anthropica uderzenie szczególnie dotkliwe dla konkretnej grupy demograficznej – kobiet. Na automatyzację narażonych jest 39,1 proc. pań wobec 22,8 proc. panów, co wynika zarówno z ich statystycznie wyższego poziomu wykształcenia, jak i intelektualnego charakteru pracy. To „różowe kołnierzyki” – kobiety pracujące w administracji publicznej, HR i usługach biurowych.

Inną grupą zagrożoną przez rozwój wielofunkcyjnych modeli AI są juniorzy. Najgroźniejszym zjawiskiem jest „odcięta drabina”. W USA firmy masowo rezygnują z rekrutacji na stanowiska juniorskie. Proste zadania, na których uczyli się początkujący, przejęły algorytmy obsługiwane przez ich przełożonych. Niezależnie od faktycznych przyczyn (od AI większy wpływ na koniunkturę USA miały choćby taryfy), taka strategia to recepta na katastrofę kompetencyjną.

Za dekadę zabraknie seniorów, a dzisiejsi juniorzy nie mają gdzie popełniać błędów i pobierać nauki.

Dyskusja o wpływie AI na ekonomię ma bezpośredni wpływ na polską gospodarkę. Pojawiają się pierwsze sygnały o redukcji zatrudnienia w centrach usług wspólnych (SSC/BPO), m.in. w Krakowie. Wskazuje to na finisz modelu opartego na outsourcingu i automatyzacji prostych procesów przez „tanich Polaków”. Jeśli te doniesienia zyskają statystyczne potwierdzenie, wymusi to kres dotychczasowej strategii Polski jako produkcyjnego „zaplecza Europy”. Do tej pory odpływ takich miejsc pracy tłumaczono rosnącymi kosztami pracy i tym, że polski informatyk zarabia więcej niż rumuński, a obecnie filipiński czy bangladeski. Przez automatyzację procesów za pomocą AI ten proces tylko przyspiesza.

Równocześnie polski sektor cyfrowy jest pod presją spadającej wydajności. Raport Sieci Badawczej Łukasiewicz wskazuje na ujemny bilans handlowy w obszarze wysokomarżowych usług cyfrowych. Innymi słowy, eksportujemy głównie czas pracy programistów, podczas gdy zyski z własności intelektualnej i infrastruktury płyną do zewnętrznych dostawców. Jako że w Polsce nie powstał do tej pory żaden „duży” (wielofunkcyjny i multimodalny) model AI, łatwo przewidzieć, jaka rola przypadnie polskim programistom w nowym rozdaniu cyfrowej gospodarki.

Przeczytaj także:

FOMO i materialny koszt wiary

W myśl zarówno technologicznych optymistów, jak i katastrofistów, ten, kto pierwszy stworzy algorytmiczną superinteligencję, uzyska nie tyle przewagę, ile w zasadzie władzę nad wszystkimi innymi graczami. Taki pogląd opiera się na wielu niesprawdzalnych dziś założeniach, przez co jego zwolenników wypadałoby nazywać „wyznawcami”. Jednak to, że podziela go tak wiele osób w sektorze cyfrowym, sprawia, że nawet ci, którzy go nie podzielają, zmuszeni są zachowywać się tak jak inni „wierni”.

Zgodnie z tym, inwestorzy giełdowi decydując o finansach w obliczu AI kierują się w dużej mierze FOMO – lękiem przed przegapieniem historycznej szansy na dostęp do uniwersalnego narzędzia do pomnażania kapitału.

„Kult AI” jak na razie przede wszystkim generuje ogromne koszty.

Agenty AI pożerają energię w tempie, którego nie przewidziały działy PR. Pojedyncze zapytanie do modelu generatywnego zużywa według szacunków około 5 razy więcej energii niż tradycyjne wyszukiwanie w Google. Wygenerowanie jednego obrazu pochłania tyle prądu, co pełne naładowanie smartfona.

Oczywiście trwa wyścig optymalizacyjny – mniejsze modele (SLM) stają się wydajniejsze. Jednak w skali makro oszczędności te są niwelowane przez paradoks Jevonsa: im tańsza staje się moc obliczeniowa, tym chętniej delegujemy agentom coraz bardziej złożone procesy. Wciąż nie wiemy, jaki jest bilans ekologiczny systemów agentowych. Agent AI nie jest pojedynczą interakcją – to pętla planowania i wielokrotnych wywołań, co prawdopodobnie tylko podbije ślad węglowy każdej operacji. To m.in. z tych powodów emisje gazów cieplarnianych Google wzrosły o 48 proc. względem 2019 roku, czyniąc deklaracje o dążeniu do „zeroemisyjności” pustymi obietnicami.

Gospodarka dla 10 procent

W USA słowo „AI” stało się doskonałą wymówką dla zarządów. CEO korporacji używają go, by maskować błędy w zarządzaniu lub dla własnego, wyrażonego w premiach kwartalnych, zysku.

Masowe zwolnienia, które kiedyś wywoływały niepokój rynku, dziś notorycznie są prezentowane jako „zwrócona ku przyszłości optymalizacja”.

Inwestorzy – często sami wspomagani przez algorytmy – reagują entuzjazmem na hasło „redukcja etatów dzięki AI”, co przekłada się na skoki wyceny akcji wielu firm. Krótkoterminowa zachęta w postaci zysku akcjonariuszy maskuje brak głębszej refleksji nad podstawami wzrostu i długofalowych strategii.

W dyskusjach o przyszłości pracy dominuje przekonanie, że w wyniku automatyzacji kapitalizm padnie, bo społeczeństwa nie będzie stać na konsumpcję.

Wiele wskazuje, że jest to kolejny mit.

Także dziś istnieją państwa, w których wysoki poziom nierówności nie przekłada się na spadek PKB. I nie chodzi wcale o położone poza centrum dyktatury. Jak donosi „Wall Street Journal”, obecnie najbogatsze 10 proc. Amerykanów odpowiada za niemal połowę wszystkich wydatków konsumenckich. Oznacza to, że najbogatsza gospodarka świata świetnie radzi sobie nawet wobec biednienia coraz większych segmentów społeczeństwa. To model „gospodarki bez mas”, który wymaga jednak istotnego elementu: zabrania obywatelom demokratycznej kontroli nad Państwem i gospodarką.

Jednocześnie AI pełni w elitach finansowych funkcję słowa-wytrychu legitymizującego skrajnie nierówny podział tortu między inwestorów i pracowników. Sztuczna inteligencja nie jest dziś narzędziem wyzwalającym, lecz parawanem dla radykalnej ekstrakcji renty i dyscyplinowania pracy. Prawdziwym produktem tej rewolucji nie jest wzrost dobrobytu, lecz model gospodarczy, w którym zysk elity jest całkowicie izolowany od kondycji ekonomicznej większości społeczeństwa. Dzięki internetowi, serwisom, a ostatnio również generatywnej i agentycznej AI ten model jest ekspresowo eksportowany w inne rejony świata.

Frazes kontra konkret

Prawdziwa efektywność stosowania sztucznej inteligencji rodzi się z analizy konkretnego procesu. Jeśli algorytm realnie poprawia marżę w logistyce, programowaniu czy diagnostyce maszyn – jest innowacją. Cała reszta to fascynujące, ale kosztowne finansowo i energetycznie eksperymenty. To świetnie, że je przeprowadzamy, ale nie bez powodu od setek lat obszar badań naukowych rządzi się innymi prawami niż przemysł, rolnictwo czy kultura.

Myślenie o roli technologii cyfrowych w gospodarce i społeczeństwie ma dziś strukturę schizoidalną. Żyjemy w momencie, w którym autentycznie nie wiadomo, czy obserwujemy rewolucję na miarę wynalezienia pisma, czy raczej kolejną odsłonę nadmiernego entuzjazmu bogaczy lokowanego w niedojrzałej technologii (metaverse, kryptowaluty i NFT, samochody wodorowe).

Nie oznacza to oczywiście, że nie można projektować innowacji cyfrowych w inne, społecznie użyteczne sposoby. Pokazują to m.in. sukcesy oddolnych projektów opartych na otwartych modelach, projekty wspierające automatyzację zadań w sektorze publicznym, aktywizmie czy spółdzielczości. Ten kierunek starają się promować kraje takie jak Indie czy Chiny, które w oficjalnej narracji (dla sceptyków: propagandzie) o AI mówią właśnie w kontekście odpowiadania na ważne społeczne potrzeby.

Ta pozytywna wizja przyszłości nie wydarzy się jednak sama. Bez zmiany ustawień „autopilota” obecny, projektowany w biurach międzynarodowych gigantów tor rozwoju AI doprowadzi nas do plutokratyczno-policyjnego modelu władzy. Zarządzanego nie przez magiczną superinteligencję, ale wąską grupę lubujących się w masażach, egzotycznych wyspach i prywatnych odrzutowcach ultrabogatych.

Zajmuje się w regulacjami sztucznej inteligencji, analizami polityk cyfrowych oraz badaniami biznesowego i społecznego wykorzystania nowych technologii. Współzałożyciel Fundacji Kaleckiego, pracował w IDEAS NCBR, NASK, OKO.press, Biurze Rzecznika Praw Obywatelskich. Publikował m.in. w Rzeczpospolitej, Gazecie Wyborczej, Polityce, Krytyce Politycznej, Przekroju, Kulturze Liberalnej, Newsweeku czy Visegrad Insight. Prawnik i kulturoznawca, absolwent Uniwersytetu Warszawskiego.

Zajmuje się w regulacjami sztucznej inteligencji, analizami polityk cyfrowych oraz badaniami biznesowego i społecznego wykorzystania nowych technologii. Współzałożyciel Fundacji Kaleckiego, pracował w IDEAS NCBR, NASK, OKO.press, Biurze Rzecznika Praw Obywatelskich. Publikował m.in. w Rzeczpospolitej, Gazecie Wyborczej, Polityce, Krytyce Politycznej, Przekroju, Kulturze Liberalnej, Newsweeku czy Visegrad Insight. Prawnik i kulturoznawca, absolwent Uniwersytetu Warszawskiego.

Komentarze