Karen Hao: Sny i koszmary w Imperium AI. Od ideologii do władzy [ROZMOWA]

Uważam AI za projekt polityczny. Liderzy AI postrzegają ludzi jako gorsze istoty w stosunku do maszyn. Chcą zbudować globalny system polityczny, w którym imperium AI podejmuje wszystkie decyzje – mówi Karen Hao. I podpowiada, co z tym może zrobić Unia Europejska.

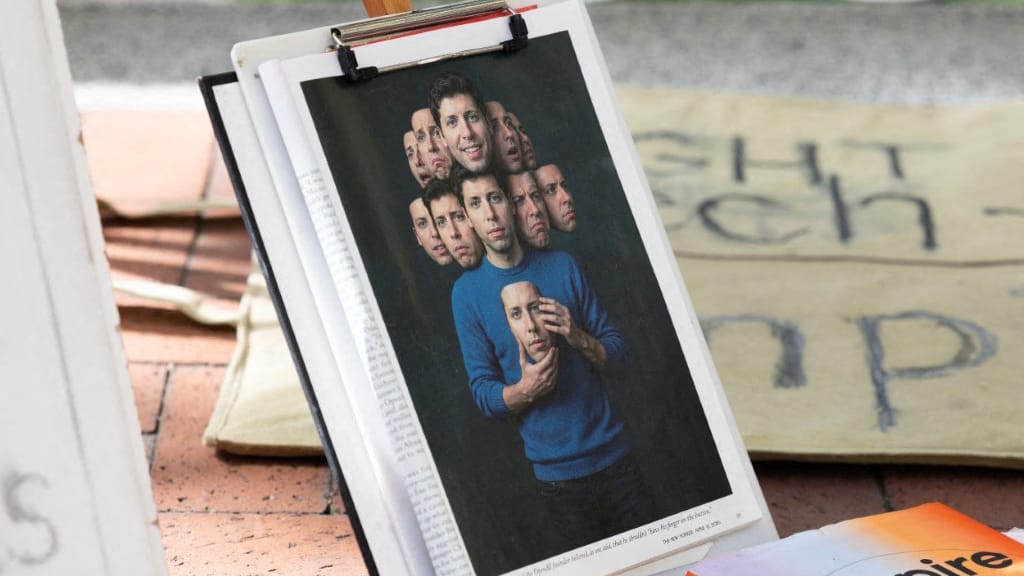

Rozmowa z Karen Hao*, autorką książki „Imperium sztucznej inteligencji. Sny i koszmary w OpenAI Sama Altmana”, właśnie wydanej po polsku przez Wydawnictwo Szczeliny. Premierę miała rok temu w wydawnictwie Penguin i od razu trafiła na listy najlepiej sprzedających się książek non fiction.

(Więcej o Karen Hao na końcu tej rozmowy)

Myślałam, że pisanie o AI będzie nudne

Jacek Mańko: Bardzo podoba mi się określenie „imperium”, ponieważ właśnie to słowo przychodzi mi do głowy, gdy sam myślę o takich firmach jak OpenAI. To trafna metafora, choć gdy się nad tym zastanowić, to wcale nie jest tylko metafora.

Porozmawiajmy o tobie i twojej książce – jak w ogóle rozpoczęła się twoja droga dziennikarska, skąd wzięło się zainteresowanie sektorem sztucznej inteligencji, a zwłaszcza OpenAI?

Karen Hao: Na początku dość przypadkowo, ponieważ studiowałam mechanikę (mechanical engineering) na MIT w Bostonie, chciałam potem pracować w sektorze technologicznym. Myślałam, że cała moja kariera będzie związana z technologią. Przeprowadziłam się więc do San Francisco i dołączyłam do startupu z obszaru zrównoważonego rozwoju miejskiego, ale szybko zdałam sobie sprawę, że to nie jest właściwy sektor dla mnie.

Choć startup miał się kierować wizją, to zarząd zwolnił prezesa (CEO) z powodu braku rentowności. Wtedy uświadomiłam sobie, że żadne z interesujących mnie problemów nie są rentowne, więc jestem w niewłaściwym miejscu.

Tak sobie wtedy naiwnie myślałam: cóż, studiowałam inżynierię, bo myślałam, że technologia będzie narzędziem zmian społecznych. Może powinnam więc spróbować z pisaniem? Przecież zawsze lubiłem pisać, więc w pewnym sensie czyni mnie to dziennikarką.

W sumie racja, wiele osób myśli podobnie.

Choć bardzo zależało mi na kwestiach związanych ze zrównoważonym rozwojem, to dostałam stanowisko dziennikarki technologicznej od sztucznej inteligencji. W ten sposób od 2018 roku zaczęłam zawodowo zajmować się tym tematem. Na początku sądziłam, że będzie to bardzo nudna rola. Nie wydawało mi się, żeby o AI było coś szczególnie ciekawego do powiedzenia.

No właśnie. Nudny, techniczny obszar dla koneserów gatunku?

Tak, myślałam, że będę pisać teksty w rodzaju: ktoś stworzył zbiór danych, wytrenował sieć neuronową i teraz system potrafi robić to, czy tamto.

Rozpoznawać kotki i pieski na zdjęciach.

Właśnie. Szybko jednak odkryłam, że już wtedy, w 2018 roku, toczyły się bardzo ciekawe dyskusje o wpływie sztucznej inteligencji na społeczeństwo. Uznałam, że będzie to odtąd moja nisza.

Mogłam skupić się na problemach, które dostrzegałam w Dolinie Krzemowej, kiedy sama tam pracowałam. Przede wszystkim fakt, że ekosystem innowacji nie jest już nastawiony na tworzenie technologii służących interesowi publicznemu. Zaczęłam więc pytać, dlaczego tak się stało i jak można odbudować system innowacji, żeby działał z korzyścią dla społeczeństwa.

Wciąż uważasz, że rozwój techniczny może działać w interesie publicznym i przynieść pozytywną zmianę? Czy twoim zdaniem coś poszło po drodze nie tak?

Absolutnie uważam, że technologia może wywołać pozytywne zmiany społeczne, ale rozwój technologii jest teraz w dużej mierze napędzany przez prywatne firmy – a konkretnie przez system venture capital (VC) z Doliny Krzemowej.

VC chodzi o ciągły wzrost za wszelką cenę, a nie o stworzenie stabilnego biznesu, który dostarcza ludziom realną wartość społeczną.

Nie chodzi o uczynienie świata lepszym miejscem

Czyli nie jesteś przekonana, że chodzi o uczynienie świata lepszym miejscem...

To ich slogan – nie, zupełnie nie jestem. Zwłaszcza że studiowałam z ludźmi, z których pewnie trzy czwarte nadal pracuje w sektorze technologicznym. Ze studiów znam kilku menedżerów średniego i wyższego szczebla z OpenAI i czasem spotykam ich na imprezach czy weselach. Wciąż jestem mocno zanurzona w tej kulturze czy etosie.

Dużo czasu poświęcam na rozmowy z informatorami z branży, słyszę, jak ludzie rozmawiają o tym prywatnie. Dlatego nie sądzę, żeby cokolwiek się zmieniło od czasu, kiedy odeszłam, a wręcz jest gorzej.

OpenAI dużo mówi o misji, może nawet za dużo. Nie wierzysz w ich deklaracje, prawda?

Nie. Ich oficjalną misją jest „zapewnić, że AGI [ogólna sztuczna inteligencja] przyniesie korzyści całej ludzkości”. Zresztą, w swoich początkach w OpenAI miała miejsce wielka filozoficzna debata, o tym, czy oni mają sami zbudować AGI, czy raczej stworzyć warunki, by ktoś inny to zrobił.

W każdym razie sformułowanie misji jest tak niejasne, że traci w ogóle sens. Między sobą nawet nie potrafili uzgodnić, czym miałaby być „AGI”, czy co to znaczy „przynosić korzyści całej ludzkości”. To wiele mówi o tej organizacji.

Gdy czytam „przynosić korzyści całej ludzkości”, myślę sobie: „Przecież to bzdura! Jak w ogóle można czymś takim przekonać inwestorów czy miliarderów, żeby dali na to dużo pieniędzy?”. Czytając twoją książką, dochodzę jednak do wniosku, że za tą górnolotną misją kryją się założenia ideologiczne, będące zarazem jednym z niezbędnych filarów do budowy imperium. Ile więc ideologii stoi za OpenAI?

Tam wszystko jest ideologią. Pierwsza ideologia, o której rzadko mówię, to przekonanie, że budowa AGI jest w ogóle czymś dobrym. Pomijając fakt, że AGI nie ma jasnej definicji, już

sama ta pogoń za de facto uczynieniem ludzi zbędnymi jest uważana przez nich za coś pozytywnego.

Ideologią jest wierzyć, że AGI to ostateczny cel, do którego powinno się dążyć, i to w ogóle bez kwestionowania leżących u podstaw założeń.

Ludzie to gorsze istoty

To jest wręcz antyludzkie, prawda?

To jest strasznie antyludzkie. Kiedy zaczynałam zajmować się AI, byłam zafascynowana tą dziedziną. Gdy ludzie mówili „chcemy odtworzyć ludzką inteligencję”, nie zastanawiałam się, czy to w ogóle jest dobry pomysł.

Dopiero po kilku latach uświadomiłam sobie, że kryje się w tym mnóstwo niewypowiedzianych założeń, które warto poddać krytyce.

Na przykład założenia filozoficzne czy o naturze ludzkiego poznania. Studiowałem kognitywistykę, wtedy sztuczna inteligencja była dla mnie intelektualnie ciekawa, np. jak takie algorytmy grają w szachy. Gdy wchodzi się w to głębiej, okazuje się, że liderzy sektora AI postrzegają ludzi, jak jakieś gorsze istoty w stosunku do maszyn.

Tak, dokładnie.

Imperia AI wyznają też ideologie dotyczące moralności, etyki czy przyszłości gatunku ludzkiego. Czy badałaś też ruchy takie jak efektywny altruizm, czy longtermizm?

Spędziłam dużo czasu, rozbierając na czynniki społeczności „AI safety”, efektywnego altruizmu czy longtermizmu i ich złowrogiego bliźniaka – akceleracjonizm.

To dwie strony tego samego medalu. Dla mnie to jest jak czytanie Biblii, gdzie jedni skupiają się na piekle czy potępieniu, a inni na niebie jako zbawieniu i motywacji dla ludzi. Tym właśnie są akceleracjonizm czy efektywny altruizm – różnią się perspektywą, ale biblijny fundament jest ten sam.

Skojarzenia z sektami

Biblijny fundament, czyli eschatologia – rozważania o ostatecznych rzeczach. Dlatego skojarzenia z sektami chyba są tu nieprzypadkowe. Czy sądzisz, że przemysł AI jest przesiąknięty takim sekciarskim myśleniem?

Tak – widać to po tym, jak szybko ludzie zmieniają swoje przekonania po wejściu do tej branży. Znam osoby, które były sceptyczne, a poszły do tych firm i stały się istnymi wyznawcami. Z kolei niektórzy odeszli i wrócili do poprzednich poglądów, a później się dziwili, że „zgubili siebie” na tamtym etapie. Dla mnie to zachowania przypominające sektę.

Wspominasz też, że naukowcy również bywają wyznawcami, co jest szczególnie widoczne w OpenAI. Ot, Ilya Sutskever – być może najzdolniejszy inżynier uczenia maszynowego na świecie – a równocześnie znany z wewnątrzfirmowego spektaklu „palenia kukły AI” czy skandowania „poczuj AGI”. To dość osobliwe.

To bardzo dziwne. Z jednej strony Ilya ma czarny humor i lubi performans, czy wygłupy i tak też można na te rytuały patrzeć. Z drugiej strony, najwyższe kierownictwo OpenAI brało w tym udział i jeszcze nakłaniali innych pracowników.

Rozmawiałam z ludźmi, którzy brali udział w tych spektaklach i niektórzy uważali je za przerażające. Inni za zabawę w integrację, a jeszcze inni za coś głębokiego, co porusza kluczowe filozoficzne fundamenty w ich pracy.

Ludzie tak traktują religijne rytuały. Mogą uważać, że są niedorzeczne, ale i tak biorą w nich udział. Inni dostrzegają w nich głęboki sens i ważne przesłanie. To świetnie ilustruje to, o czym rozmawiamy, czyli

ideologię przypominającą kult i religijny ferwor, jakie mają miejsce w firmach AI.

Uważasz, że to pomaga w budowaniu imperium czy pozyskiwaniu inwestorów i wyznawców?

Głoszenie czegoś na kształt religii to najskuteczniejszy sposób, by skłonić ludzi do ignorowania krytyki czy skupieniu się na czymś większym od nich samych.

Choć faktycznie, staje się to znacznie trudniejsze, w sytuacji, kiedy reputacja firmy zaczyna podupadać z powodu nagłaśnianych nieetycznych praktyk, czy rosnącego społecznego sprzeciwu.

Dlatego książkę zaczynam od cytatu Sama Altmana, który mówi, że „ludzie odnoszący największe sukcesy tworzą religię”. Wydaje mi się, że najłatwiejszym sposobem zbudowania religii jest dziś właśnie założenie firmy.

Altman bardzo wcześnie zrozumiał, że ludzie potrzebują systemu wierzeń, potrzebują czegoś, czego mogą się chwycić, a poprzez wiarę można motywować ludzi do skrajnych poświęceń – i zatrzymać największe talenty w firmie.

Wyższa klasa ludzi

Gdy Altman był jeszcze na Stanfordzie, jego mentorem był Peter Thiel – prorok Ciemnego Oświecenia. O Thielu wiadomo też, że potrafił dobierać pracowników pod kątem wysokiego IQ. Myślę, że obydwaj mają bardzo niepokojącą wizję tego, co to znaczy być człowiekiem i jacy ludzie zasługują na więcej. Obydwaj zakładają istnienie jakiejś wyższej, elitarnej klasy ludzi.

Uważam, że ten cały pomysł mierzenia inteligencji zawsze miał źródło w chęci udowodnienia, że niektórzy ludzie są lepsi od innych. A obsesja na punkcie odtworzenia ludzkiej inteligencji i znalezienia idealnych miar do stworzenia „doskonałego człowieka” jest częścią ideologii eugenicznej. Pragnienia zdefiniowania, co oznacza „wyższość”, a następnie jej odtworzenia. Oczywiście ich definicje „wyższości” są odbiciem nich samych.

Tak jak Bóg stworzył ludzi na swój obraz, tak oni chcą stworzyć AI na swój. Nie jestem przesadnie religijny, ale to brzmi jak bluźnierstwo. I bardzo wąskie ujęcie człowieczeństwa.

Gdy spojrzysz na kryteria używane do oceny modeli AI, to zauważysz, że opierają się na umiejętnościach cenionych w sektorze technologicznym. Programowanie, matematyka, testy z biologii, rozwiązywanie zagadek – to dosłownie są pytania rekrutacyjne w firmach technologicznych.

A jeden z benchmarków AI nieprzypadkowo nosi nazwę „Ostatni egzamin ludzkości”. W ideologiach wokół sztucznej inteligencji jedni widzą zbawienie, tak zwani boomerzy, a inni – doomerzy – zagładę. Choć są to dwie strony tego samego medalu, stoi za nimi podobnie mroczne rozumowanie. Jego rewers widać już dziś: niedawno rzucono koktajlem Mołotowa pod dom Sama Altmana, a sprawca był związany z ruchem doomerów.

Czy przemoc fizyczna w USA, gdzie napięcia polityczne i tak są już bardzo duże, może jeszcze nasilić się pod wpływem technologii AI?

Nie chcę, żeby tak się stało i absolutnie tego nie popieram. Jednak nierówności w USA są ogromne, wiele osób jest zdesperowanych, czy w złym stanie psychicznym. A jeśli ktoś obarczy winą konkretną osobę, taką jak Sam Altman, przemoc może się powtarzać. To niczego rozwiąże – pogłębi tylko polaryzację, zamiast umożliwić konstruktywną debatę o innym kierunku rozwoju AI.

Jednocześnie elity technologiczne – chyba nieprzypadkowo – zmieniają nieco ton. Elon Musk proponuje bezwarunkowy dochód podstawowy, Altman mówi o skróceniu tygodnia pracy. Chyba zdają sobie sprawę, że „poddani” zaczynają się buntować, więc może trzeba im coś dać, żeby nie wystąpili przeciwko nim.

Mówiąc o poddanych, oni dosłownie mówią, co się stanie, gdy „przyjdą po nas z widłami”. To autentyczny język, którego używają.

Powodów do niezadowolenia z władzy imperium więc nie brakuje. Piszesz też, że oprócz ideologii innym filarem imperium AI jest władza i polityka. Czy mogłabyś rozwinąć, dlaczego AI jest kwestią polityczną?

Mam na myśli to, że jednym z ostatecznych celów imperium jest przekonanie społeczeństw, że nie mają żadnej sprawczości. Można to robić na wiele sposobów.

Imperium mówi wprost: AI jest nieunikniona, nic nie da się z tym zrobić, nie można tego zatrzymać. Wpływają też na prawo i lobbują za rozwiązaniami, które odbierają ludziom możliwość działania, na przykład wymuszając utajnienie informacji o wpływie centrów danych na środowisko.

Dwa tygodnie temu „Le Monde” opisał, że lobby technologiczne odniosło spory sukces, wprowadzając klauzulę poufności do jednego z projektów Komisji Europejskiej. Zgodnie z tą klauzulą firmy, ze względów komercyjnych, nie musiałyby ujawniać wpływu poszczególnych centrów danych na środowisko, a jedynie dane zbiorcze.

Odbieranie sprawczości

To odbiera sprawczość lokalnym społecznościom, bo to w ich otoczeniu powstają takie obiekty, a zarazem społeczności te nie mogą decydować, czy w ogóle chcą te centra u siebie.

Imperium odbiera sprawczość także w ten sposób, że przejmuje dane i twierdzi, że od teraz są ich zasobem. Tymczasem zasoby te to własność ludzi czy zbiorowości, które włożyły ogrom pracy w ich stworzenie. A dziś traktuje się je jedynie jak jedne z wielu danych.

No tak, źródło danych, jak każde inne.

Właśnie dlatego uważam AI za projekt polityczny. Chodzi o próbę zbudowania globalnego systemu politycznego, w którym istnieje tylko jeden dominujący gracz – podejmujący wszystkie decyzje – i jest nim samo imperium.

Jeden dominujący gracz – to by też tłumaczyło, dlaczego konkurencyjne firmy AI się nie znoszą, a podczas szczytu AI w Indiach Sam Altman i jego były współpracownik Dario Amodei nie podali sobie ręki i to stojąc obok premiera Modiego. To bardzo groteskowe.

Właśnie. Te firmy skaczą sobie do gardeł po to, by stać się najważniejsze.

Podczas niedawnego spotkania w Centrum Nauki Kopernik w Warszawie powiedziałaś, że wśród technologicznych miliarderów teraz każdy chce mieć własną firmę AI. Już wolałem, jak rywalizowali, kto ma największy jacht.

Skłoniło mnie to do refleksji, że kiedy w Polsce i na świecie, mniej więcej trzy lata temu, zaczynaliśmy coraz bardziej sceptycznie podchodzić do mediów społecznościowych i uświadamiać sobie, że nie są one tym, czym miały być według obietnic, jednocześnie pojawił się ogromny hype na modele językowe.

Myślałam sobie wtedy: ludzie, to jest przecież dokładnie ten sam mechanizm. To te same firmy, ci sami ludzie, te same zasoby. Jak można nie lubić mediów społecznościowych i jednocześnie takim entuzjazmem darzyć sektor AI?

Myślę, że ludzie byli autentycznie zaciekawieni Samem Altmanem, ponieważ był kimś nowym. Pamiętam, gdy pracowałam w Wall Street Journal, jak pojawił się ChatGPT, a redaktor naczelny pytał: „Kim jest ten facet? Skąd się wziął?”.

Uświadomiłam sobie wtedy, że ludzie, którzy nie śledzili branży technologicznej, nie mieli o nim pojęcia. Bycie przez Altmana prezesem Y Combinator, największej firmy wspierającej technologiczne startupy, niewiele znaczyło poza branżą. Aż nagle ludzie pomyśleli, że on jest inny niż reszta. Choć jest mniej więcej taki sam. Rewolucję AI przedstawiono światu przez twarz Sama Altmana.

Manipulowanie opinią publiczną

Wilk w owczej skórze. A efektem tej „rewolucji” jest zagrożenie nie ze strony „nadludzkich” możliwości AI, ile z powodu czysto biznesowej logiki: management cię zwolni i zastąpi gorszym narzędziem. W efekcie cierpi np. dziennikarstwo, cierpi edukacja, ale wygląda na to, że niewiele osób się tym przejmuje, bo najważniejsze jest przejęcie kontroli nad pracą i jej kosztami.

Czy spotykasz się w swojej z takim sposobem myślenia o AI?

Tak, to się wszystko sprowadza się do idei politycznego projektu, gdzie próbuje się pozbawić ludzi sprawczości. Chodzi o to, jak przebudować gospodarkę w taki sposób, by przekonać pracowników, że jeśli nie są w stanie przetrwać, to jest to ich indywidualna porażka, a nie wada systemu.

Sposób, w jaki w ramach imperium porusza się kwestie pracownicze, bardzo wiele zdradza o tym, jak próbuje się manipulować opinią publiczną.

To odczłowiecza na poziomie psychologicznym, a jednocześnie pozbawia sprawczości i wpływu na to, jak wykonuje się swoją pracę. Czy angażujesz się w jakieś ruchy oporu środowisk pracowniczych wobec AI?

Jeśli przez zaangażowanie rozumiesz to, że rozmawiam z pracownikami, opisuję ich jako dziennikarka, to tak, jestem bardzo zaangażowana. Nie dołączam jednak do samych ruchów czy związków zawodowych.

Uważam, że wszystkie te inicjatywy są niezwykle ważne. Stanowią kluczowy element pociągania firm do odpowiedzialności, nadzór powinien pochodzić zarówno od rządu, jak i od obywateli.

Szczególnie w USA, gdzie rząd jest obecnie całkowicie nieobecny, a wręcz wspiera imperium i odgrywa tu szkodliwą rolę. Oddolne ruchy społeczne są jedynym mechanizmem pozwalającym rozliczać branżę technologiczną.

Są już takie ruchy, które zaczynają odnosić realne sukcesy. Zamknięcie projektu SORA (tworzenie przez narzędzia AI filmu na podstawie tekstu) można bezpośrednio powiązać z protestami przeciwko centrom danych.

Do tego dochodzi sprzeciw Hollywood oraz pozwy artystów. W praktyce ten projekt stał się zbyt kosztowny politycznie i finansowo, a do tego pochłaniał zasoby obliczeniowe potrzebne innym przedsięwzięciom.

Do tego dochodzi jeszcze dezinformacja, zalew AI slopu?

Owszem, ale to nie dlatego zamknęli ten projekt. Oni nie przejmują się tym, co to produkuje; chodzi o to, że koszt projektu przekroczył ich próg gotowości do utrzymania. To dla mnie niezwykłe, bo ta aplikacja została uruchomiona zaledwie kilka miesięcy wcześniej, rzekomo jako najlepsza od czasu ChatGPT.

I miała wysłać Hollywood na bezrobocie…

Tak. Trzeba też rozumieć wewnętrzną dynamikę OpenAI. Sam Altman jest w stanie zatrzymać w firmie utalentowanych pracowników między innymi dlatego, że praktycznie nikomu nie mówi „nie”.

Tyle że skutkiem tego OpenAI angażuje się wiele różnych projektów. I nie ma spójnej strategii. A każdy pracownik, który ma ciekawy pomysł, zazwyczaj dostaje zielone światło do jego realizacji.

W przypadku SORA, którym kierowali jedni z najbardziej cenionych i doświadczonych pracowników, decyzja o zamknięciu wiązała się z ryzykiem ich odejścia do konkurencji.

To pokazuje, jak wysoki stał się koszt takich decyzji, do tego stopnia, że mimo wszystkich tych ryzyk firma i tak zdecydowała się projekt zamknąć. To bardzo mocny przykład na to, jak zorganizowany opór może realnie wpływać na decyzje firm i jak ogromne znaczenie może mieć presja społeczna wywierana nawet przez zwykłych ludzi.

Skuteczność związków zawodowych

Czyli niby taka nowoczesna technologia, a stare dobre związki zawodowe czy inne formy organizacji pracowników wciąż mogą być skuteczne w walce z imperium.

Organizowanie się pracowników jest jednym z kluczowych mechanizmów pozwalających przeciwdziałać problemom związanym z rozwojem sztucznej inteligencji i powstrzymywać nieodpowiedzialne wdrażanie tej technologii.

Widzimy to na całym świecie. Są udokumentowane setki przykładów ruchów pracowniczych, w których ludzie stawiają opór – strajki scenarzystów, kenijscy anotatorzy danych się organizuję, nawet fabrykach chipów powstają związki zawodowe.

To bardzo ważny mechanizm. Nie oznacza to oczywiście, że związki zawodowe w ich obecnej formie są doskonałe, być może trzeba je nieco uwspółcześnić. Sama idea organizowania się pracowników wcale nie jest przestarzała. Nie jest.

Dokumentując rozwój imperium sztucznej inteligencji, podróżowałaś po całym świecie. Patrząc z tej perspektywy, jakie jeszcze dostrzegasz koszty i ryzyka?

Skala dewastacji ekologicznej czy zdrowia publicznego jest po prostu ogromna. W przypadku budowy tak wielkiej liczby centrów danych skutki środowiskowe są szczególnie widoczne, co czasem może umykać opinii publicznej.

Dane, które często w tym kontekście przywołuję, dotyczą superkomputera AI firmy Meta, budowanego w Luizjanie – obiekt ten ma być 400 razy większy niż pierwsze centrum danych firmy, które „tylko” obsługiwało Facebooka.

To centrum superkomputerowe ma docelowo zajmować powierzchnię porównywalną z jedną piątą powierzchni Manhattanu i zużywać tyle energii, ile wynosi średnie zapotrzebowanie całego Nowego Jorku – a mówimy tylko o jednym obiekcie.

Jeśli zsumować wszystkie planowane obiekty, prognoza przygotowana przez McKinsey & Company wskazuje, że w scenariuszu ostrożnym do 2030 roku zużycie przez nie energii wyniosłoby półtora raza tyle, ile obecnie zużywają całe Niemcy. W scenariuszu przyspieszonym byłoby to aż czterokrotność zużycia energii Niemiec – już w ciągu pięciu lat. A dla tych firm to dopiero początek.

Król jest nagi

Z drugiej strony zapowiadane centra danych wcale nie powstają tak prędko, AGI coś nie widać na horyzoncie, sporo się mówi o bańce AI. Skoro mowa o imperium, to czy król nie jest nagi?

Zgadzam się, że król jest nagi. I myślę, że ludzie zaczynają to dostrzegać. To jeden z powodów, dla których sprzeciw wobec AI się nasilił. Wcześniej reakcje były bardziej zachowawcze, ponieważ wiele osób wierzyło, że sztuczna inteligencja może przynieść realne korzyści, i być może cena, jaką trzeba zapłacić, jest tego warta.

Teraz jednak coraz więcej ludzi zaczyna myśleć: chwila moment, ta cała AI wcale nie przynosi obiecanych korzyści, a kosztuje tak dużo, więc co my tu w ogóle robimy? Właśnie to nadało krytyce ogromnego impetu.

Czy pokusiłabyś się o jakieś prognozy, jak może rozwinąć się ta sytuacja?

Nie zajmuję się przewidywaniem przyszłości, cała moja praca opiera się na przekonaniu, że jutro jest wytwarzane przez to, co robimy dzisiaj. Przyszłość nie jest z góry zapisana. Chciałabym natomiast zobaczyć coraz więcej ludzi, społeczności i organizacji, które zaczynają rozumieć, że mają ogromną sprawczość w kształtowaniu rozwoju technologii.

Jeśli ludzie nie zgadzają się z tym, co się dzieje, powinni stawiać opór, odmawiać, podejmować działania wywierające presję na firmy, aby zmieniły swoje praktyki. Ten impet już istnieje i zaczyna realnie uderzać w te korporacje.

Jeśli presja społeczna będzie naprawdę szeroka, to nie wydaje mi się, żeby te imperia długo przetrwały.

Unia Europejska na rozdrożu

Jak wyobrażasz sobie rolę Unii Europejskiej, a szczególnie Polski? Mamy bardzo dobry system edukacji, świetne talenty pracujące w OpenAI, które traktujemy niemal jak piłkarzy, grających dla topowych zagranicznych klubów.

Unia Europejska jest jednym z nielicznych znaczących aktorów politycznych, którzy mogą stanowić realną przeciwwagę dla branży technologicznej. Już dziś istnieje wiele przepisów, które właściwie egzekwowane, a nie osłabiane, mogłyby bardzo wiele zdziałać.

Mam tu na myśli zwiększenie przejrzystości, dalszą ochronę prywatności danych tak, aby nie były wykorzystywane do trenowania modeli, zobowiązywanie firm do raportowania wpływu ich infrastruktury na środowisko, a także przepisy wzmacniające prawa pracownicze i umożliwiające organizowanie się pracowników. To wszystko jest niezwykle budujące.

Drugą rzeczą, którą UE naprawdę powinna zrobić, jest przedstawienie innej wizji rozwoju AI i finansowania jej. Czyli inwestowanie w praktyczne i użyteczne rozwiązania, a niekoniecznie wielkoskalowe, oraz wykorzystanie talentów państw członkowskich – w tym oczywiście Polski – do realizacji tej wizji.

Widzę dziś jednak w UE dojmujący brak wiary: „Widocznie zawiedliśmy, skoro nie mamy własnych technologicznych gigantów, zatem poluźnijmy regulacje i spróbujmy zbudować kopię tego, co zrobiły te amerykańskie firmy. Po prostu zbudujmy chatboty oparte o duże modele językowe”.

To całkowicie błędne podejście i może osłabić Europę tak samo, jak dziś osłabia Stany Zjednoczone.

Odradzałabyś Europie startowania w tym „wyścigu AI” donikąd?

Właśnie. To będzie katastrofalne dla planety, dla społeczności na całym świecie, a także politycznie szkodliwe dla europejskich przywódców. Tak jak dziś 80 proc. Amerykanów obawia się AI i rozlicza polityków za złe decyzje w tej sprawie, tak samo stanie się w Europie, jeśli pójdzie tą samą drogą, co amerykańskie firmy. Konsekwencje, które widzimy teraz w USA, przeniosą się tutaj.

Zgadzam się. Dlatego na zakończenie chciałbym wrócić do punktu wyjścia i zapytać, czy nie powinniśmy sprawić, by technologia znów stała się „nudna”, czyli bardziej wyspecjalizowana, skoncentrowana na technicznych detalach oraz praktycznych, przyziemnych zastosowaniach?

Myślę, że pod pewnymi względami rzeczywiście musimy „cofnąć zegar”. Nie chodzi jednak o dosłowny powrót do przeszłości. Tamten okres także miał wiele wad i brakowało demokratycznej partycypacji w zarządzaniu rozwojem AI.

Dziś sytuacja jest inna, bo ludzie wypracowali już zdolność do oddolnego organizowania się i partycypacji w kształtowaniu polityki wobec sztucznej inteligencji.

Jeśli połączymy powrót do mniejszych, bardziej wyspecjalizowanych modeli z silną infrastrukturą społeczną, która właśnie się tworzy, to myślę, że te dwa elementy razem mogą wyznaczyć znacznie lepszą drogę naprzód i uczynić świat choć trochę lepszym miejscem.

Dziękuję, to dobre podsumowanie naszej rozmowy.

*Karen Hao jest wielokrotnie nagradzaną dziennikarką zajmującą się wpływem sztucznej inteligencji na społeczeństwo. Współprowadzi podcast BBC „The Interface” oraz publikuje artykuły m.in. w magazynach More Perfect Union i The Atlantic. Jest również współtwórczynią serii „AI Spotlight” organizowanej przez Pulitzer Center – programu, w ramach którego przeszkolono tysiące dziennikarzy z całego świata w zakresie relacjonowania tematów związanych ze sztuczną inteligencją.

Wcześniej była reporterką Wall Street Journal, zajmującą się amerykańskimi i chińskimi firmami technologicznymi, a także redaktorką ds. sztucznej inteligencji w MIT Technology Review. Za swoje reportaże otrzymała wiele wyróżnień, w tym American Humanist Media Award, American National Magazine Award dla dziennikarzy poniżej 30 roku życia oraz wyróżnienie TIME100 AI. Uzyskała tytuł licencjata w dziedzinie inżynierii mechanicznej na MIT.

Asystent w Katedrze Zarządzania w Społeczeństwie Sieciowym w Akademii Leona Koźmińskiego. Do zainteresowań naukowych należą kształtowanie się postaw tożsamościowych w mediach społecznościowych, interakcja człowiek-AI, poznanie społeczne, a także wpływ rozwoju technologicznego oraz przemian społeczno-ekonomicznych na rynek pracy, jak również na sensowność pracy jako takiej.

Asystent w Katedrze Zarządzania w Społeczeństwie Sieciowym w Akademii Leona Koźmińskiego. Do zainteresowań naukowych należą kształtowanie się postaw tożsamościowych w mediach społecznościowych, interakcja człowiek-AI, poznanie społeczne, a także wpływ rozwoju technologicznego oraz przemian społeczno-ekonomicznych na rynek pracy, jak również na sensowność pracy jako takiej.

Komentarze