Świadomość: najtwardszy orzech nauki. Czy w końcu go rozgryziemy?

Wiesz, że jesteś sobą. Czujesz ból zęba inaczej niż ból głowy czy smak kawy, widzisz czerwień jako czerwień, a nie jako wynik obliczeń. I właśnie ta oczywistość jest dla nauki kłopotliwa. Jak to możliwe, że z 1,5-kilogramowego organu wyłania się przeżywanie?

W potocznym sensie świadomość to „bycie przytomnym” i „wiedza, że coś się dzieje”. W sensie naukowym robi się trudniej, bo jedna etykieta przykrywa kilka zjawisk naraz:

- poziom czuwania (czy jesteś przytomny),

- treść doświadczenia (co konkretnie przeżywasz),

- poczucie „ja” (że to tobie się przydarza)

- oraz zdolność raportowania i kontroli zachowania (czy potrafisz o tym powiedzieć i na tej podstawie działać).

Naukowcy wciąż nie mają jednej wspólnej definicji i spierają się nie tylko o mechanizmy, ale nawet o to, co dokładnie próbują uchwycić.

To nie jest akademicka czepialskość. Jeśli nie wiemy, czym jest mierzony obiekt, to nie wiemy, czy wskaźnik jest trafny. A świadomości nie da się „zobaczyć” bezpośrednio – jedynym pewnikiem jest to, że ja ją mam. U innych ludzi wnioskujemy po zachowaniu albo po biosygnaturach w aktywności mózgu.

To prowadzi do fundamentalnego kłopotu metodologicznego: jak zweryfikować miarę czegoś, do czego nie mamy niezależnego dostępu?

Przeczytaj także:

Mózg jako maszyna stanów i integracji

Z perspektywy fizjologii najbezpieczniej jest mówić o tzw. neuronalnych korelatach świadomości (NCC). Wiemy, że bycie świadomym wymaga odpowiedniego poziomu pobudzenia i podtrzymania globalnej „gotowości” mózgu do przetwarzania. Anestezja (znieczulenie) ogólna potrafi tę gotowość „anulować” w sposób, który fenomenologicznie przypomina wyłączenie światła: jest ciągłość ciała, ale urywa się ciągłość przeżyć.

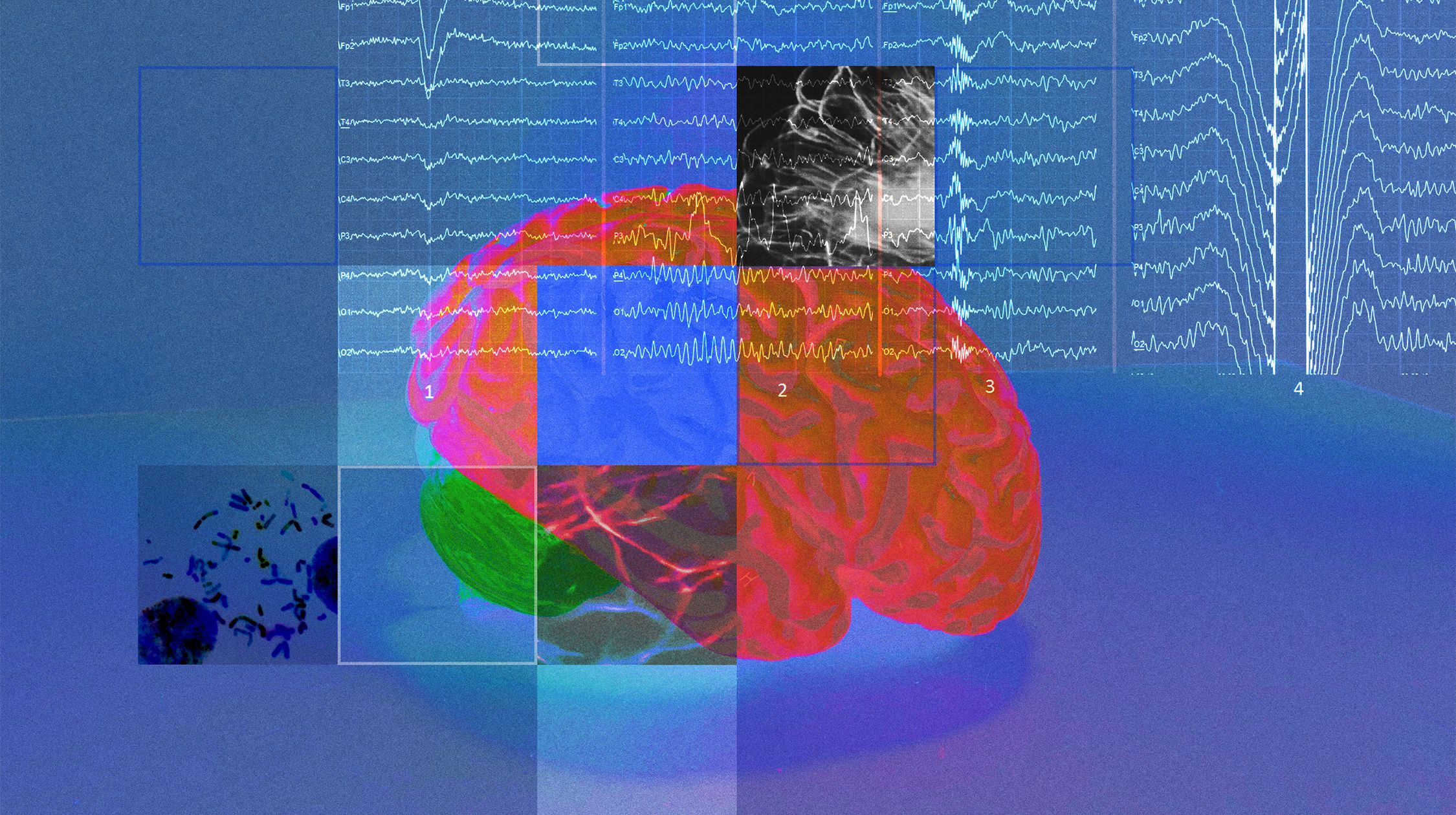

Kluczowy trop, który wraca jak refren, to złożoność dynamiki sieci mózgowych. Zespół Marcella Massiminiego rozwinął podejście, w którym mózg pobudza się impulsem przezczaszkowej stymulacji magnetycznej (TMS), a EEG rejestruje, czy odpowiedź rozlewa się po sieci w bogaty, wieloogniskowy sposób, czy gaśnie lokalnie.

Ta różnica bywa uderzająca. W czuwaniu i śnieniu fala aktywności potrafi wędrować i rozgałęziać się, w głębokim śnie czy przy znieczuleniu – zapada się w krótką, mało złożoną odpowiedź.

Z tego wyrosła miara znana jako tzw. wskaźnik złożoności perturbacyjnej (PCI) – liczba, która w praktyce klinicznej bywa użyteczna do szacowania „stopnia świadomości” u pacjentów z zaburzeniami świadomości. I to ważne rozróżnienie: PCI może mówić nam, czy mózg ma architekturę i dynamikę sprzyjającą przeżywaniu, ale nie powie, co dokładnie jest przeżywane.

Takie wskaźniki zbliżają nas do „warunków brzegowych” świadomości, lecz nie zamykają zagadki jakości doznań – dlaczego „ból zęba” jest inny niż „ból głowy”, a „czerwień” ma swoją nieprzekładalną „czerwoność”.

Do tego dochodzi jeszcze jeden, prowokujący fakt: ogromna część mózgu jest aktywna, a jednak nie wydaje się kluczowa dla świadomości wprost. Warto wspomnieć m.in. móżdżek – strukturę z olbrzymią liczbą neuronów, a mimo to (w dominującym ujęciu) niebędąca centralnym generatorem świadomych treści.

David Chalmers ukuł słynne rozróżnienie: są „łatwe problemy” świadomości (w sensie metodologicznym), jak uwaga, integracja informacji, raportowanie, decyzje, a jest „twardy problem” – dlaczego i jak procesy fizyczne mają w ogóle subiektywny wymiar, czyli „jak to jest być” danym organizmem.

Nawet jeśli znajdziemy wiarygodne markery stanu świadomego i opiszemy sieci odpowiedzialne za dostęp do informacji, pozostaje przepaść między opisem mechanizmu a opisem przeżycia. Tim Bayne nazywa to „luką wyjaśnieniową” i przyznaje, że żadna teoria nie „zamyka” jej w pełni.

Jest też drugi powód trudności, bardziej przyziemny, ale bezlitosny: problem pomiaru. Jeśli pytasz kogoś „czy byłeś świadomy?”, opierasz się na raporcie. A raport to już proces poznawczy, językowy, motywacyjny, czasem niemożliwy (niemowlęta, osoby w śpiączce, zwierzęta, AI).

W Scientific American świetnie widać tę pułapkę na przykładzie snu wolnofalowego: zwykle uznaje się go za pozbawiony marzeń sennych, a jednak zdarzają się raporty snów – więc co jest prawdą odniesienia?

Przeczytaj także:

Gdzie „mieści się” świadomość?

Współczesna nauka o świadomości nie cierpi na brak pomysłów – cierpi na nadmiar konkurencyjnych wyjaśnień. Dobrym, uporządkowanym przeglądem jest syntetyczny tekst Anila Setha i Tima Bayne'a, który zestawia główne rodziny teorii i pokazuje, że często różnią się one tym, który aspekt świadomości biorą za centralny.

Hipoteza globalnej przestrzeni roboczej (GNWT) opisuje świadomość jako moment „globalnego udostępnienia” informacji: treść staje się świadoma, gdy zostaje rozgłoszona do szerokiej sieci (zwykle wiązanej z obszarami czołowo-ciemieniowymi), dzięki czemu może zostać użyta do raportowania, planowania i kontroli zachowania. Ta teoria dobrze pasuje do intuicji, że „świadome to dostępne dla wielu systemów naraz”.

Z kolei teoria zintegrowanej informacji (IIT) idzie inną drogą: zaczyna od właściwości doświadczenia (jest jednocześnie zróżnicowane i zintegrowane) i szuka struktur fizycznych, które realizują taki typ integracji. W konsekwencji IIT bywa interpretowana jako teoria „ontologicznie odważna”, bo sugeruje, że świadomość może przysługiwać systemom innym niż mózg, o ile spełniają kryteria zintegrowanej struktury przyczynowej.

Teorie świadomości wyższego rzędu (HOT) podkreślają, że stan staje się świadomy wtedy, gdy mózg ma o nim reprezentację wyższego rzędu – gdy w pewnym sensie „wie, że wie”. To podejście szczególnie interesuje się samoświadomością i metapoznaniem.

Teoria re-entry (oraz podejścia pokrewne) akcentuje pętle zwrotne i predykcję: mózg nie tyle rejestruje świat, co stale go modeluje, a świadomość może wynikać ze stabilnego, spójnego dopasowania przewidywań do danych – w tym danych płynących z wnętrza ciała.

Najciekawsze jest jednak to, że teorie zaczęły być testowane w sposób „twardy”, porównawczy, a nie przez luźne dopasowywanie wyników do narracji.

Głośnym przykładem jest współpraca konsorcjum Cogitate, które zestawiło przewidywania GNWT i IIT w ramach wieloośrodkowych eksperymentów. W skrócie: żadna ze stron nie wyszła bez szwanku, a część „kluczowych” przewidywań okazała się trudna do utrzymania w danych. To dokładnie ten rodzaj tarcia z rzeczywistością, który – paradoksalnie – może popchnąć dziedzinę do przodu.

W tle tych sporów pojawia się też konkretne pytanie o neuroanatomię: czy najważniejsze mechanizmy treści świadomej są bardziej „z tyłu” (obszary czuciowe i integracyjne), czy „z przodu” (obszary kojarzone z kontrolą i raportem).

Relacje z badań Cogitate i ich interpretacje w mediach sugerują, że prosty obraz „świadomość siedzi w korze przedczołowej”, jest co najmniej niepewny, a mocne sygnały dotyczące treści mogą częściej pojawiać się w tylnej korze.

Świadomość poza człowiekiem

Jednym z najbardziej „namacalnych” obszarów badań nad świadomością jest medycyna – zwłaszcza diagnostyka pacjentów, którzy nie komunikują się w oczywisty sposób.

W stanie minimalnej świadomości (MCS), zespole zamknięcia czy tzw. ukrytej świadomości (gdy pacjent wygląda na nieświadomego, ale zachowuje zdolność intencjonalnego przetwarzania), stawką są nie tylko decyzje terapeutyczne, lecz także etyka: cierpienie, prawo do rehabilitacji, a czasem decyzje o podtrzymywaniu życia.

Dwa nurty badań miały tu przełomowe znaczenie.

Pierwszy to prace z użyciem fMRI i poleceń „wyobrażeniowych” (np. wyobrażanie sobie gry w tenisa), które potrafiły ujawnić intencjonalną aktywność mózgu u części osób spełniających kliniczne kryteria stanu wegetatywnego – klasyczny przykład to publikacja Adriana Owena i współpracowników w Science.

Drugi to podejścia oparte na „złożoności odpowiedzi mózgu”: zamiast pytać pacjenta o cokolwiek, mózg jest krótko pobudzany (np. TMS), a EEG rejestruje, czy odpowiedź jest bogata, rozproszona i trudna do skompresowania – co stało się podstawą opisania PCI w Science Translational Medicine.

Równolegle coraz mocniej przesuwa się granica pytania „kto może mieć doświadczenie?”. W przypadku zwierząt nauka odchodzi od traktowania świadomości jako wyłączności człowieka, a zaczyna mówić o niej ostrożnie, ale coraz konkretniej – w kategoriach stopnia prawdopodobieństwa i jakości dowodów.

Symbolicznym punktem tej zmiany była Cambridge Declaration on Consciousness, podpisana przez grupę neurobiologów i badaczy poznania, wskazująca, że wiele gatunków ma neuroanatomiczne i neurofizjologiczne „substraty” sprzyjające świadomemu doświadczeniu.

Dalszy krok wykonała New York Declaration on Animal Consciousness, formułując konserwatywny (ale znaczący) zakres zgody: silne wsparcie dla przypisywania świadomego doświadczenia innym ssakom i ptakom oraz „realistyczna możliwość” świadomości także u części bezkręgowców. To przesunięcie ma konsekwencje etyczne i regulacyjne: jeśli świadomość (a więc i zdolność do cierpienia) jest szerzej rozpowszechniona, zmienia się ciężar dowodu w debatach o dobrostanie i praktykach hodowlanych czy laboratoryjnych.

Wreszcie sztuczna inteligencja. Dzisiejsze systemy potrafią prowadzić rozmowę tak sugestywnie, że dla wielu osób brzmią jak ktoś, kto „ma wnętrze”. Ale w naukowej dyskusji liczy się nie wrażenie, tylko mechanizmy.

David Chalmers argumentuje, że współczesne modele językowe napotykają poważne przeszkody (m.in. brak zjednoczonej agencji i architektur właściwych dla „przestrzeni roboczej”), choć nie wyklucza, że przyszłe systemy mogą te braki obejść.

Z kolei raport Butlina proponuje podejście „wskaźnikowe”: zamiast kłócić się metafizycznie, sprawdzajmy, w jakim stopniu konkretne systemy spełniają obliczeniowo zdefiniowane „indykatory” wynikające z najlepszych teorii świadomości. Autorzy sugerują, że obecne systemy raczej nie są świadome, ale nie widzą oczywistych barier technicznych, by budować systemy bliższe tym wskaźnikom.

Świadomość kwantowa: kusząca, ale czy konieczna?

Kiedy klasyczna neurobiologia rozbija się o pytanie „dlaczego w ogóle istnieje przeżywanie?”, część osób odruchowo spogląda na fizykę kwantową.

Najbardziej znaną propozycją jest Orch OR Rogera Penrose'a i Stuarta Hameroffa, która wiąże świadomość z procesami kwantowymi w mikrotubulach neuronów oraz z hipotezą szczególnego rodzaju redukcji stanu.

Najpoważniejszy zarzut wobec kwantowego mózgu jest w gruncie rzeczy prozaiczny. Mózg nie jest laboratorium kriogenicznym, tylko ciepłym, mokrym i chemicznie ruchliwym środowiskiem, w którym cząsteczki bez przerwy zderzają się, drgają, emitują i absorbują fotony, a ładunki elektryczne wędrują wśród jonów.

W mechanice kwantowej stan układu może istnieć jako superpozycja (mówiąc obrazowo: „naraz w kilku wariantach”), a różne składniki superpozycji mogą ze sobą interferować – i to jest paliwo dla obliczeń kwantowych. Żeby to działało, układ musi zachować koherencję, czyli uporządkowaną relację faz między składnikami superpozycji.

Dekoherencja to proces, w którym ta koherencja znika dla układu obserwowanego osobno, bo układ nieuchronnie wchodzi w interakcje z otoczeniem. Środowisko „podgląda” stan układu przez niezliczone mikroskopijne oddziaływania (zderzenia, fluktuacje pól, wibracje), a w efekcie informacja o fazach „rozlewa się” na ogromną liczbę stopni swobody otoczenia. W praktyce oznacza to, że układ zaczyna zachowywać się jak klasyczna mieszanina.

I tu wchodzi argument Maxa Tegmarka. W swojej analizie policzył on orientacyjne czasy dekoherencji dla stopni swobody, które miałyby przenosić „nietrywialne” stany kwantowe związane z przetwarzaniem informacji w mózgu.

Wniosek: typowe czasy dekoherencji wychodzą rzędu 10-13 do 10-20 sekundy, podczas gdy istotne skale czasowe dla neuronów i procesów poznawczych to milisekundy do dziesiątych części sekundy (mniej więcej 10-3 do 10-1 s).

Innymi słowy: zanim mózg zdążyłby „wykonać” sensowną operację obliczeniową w takim reżimie, koherencja zostałaby już dawno zniszczona przez otoczenie. To oznacza, że nasz mózg nie działa jak komputer kwantowy.

Zwolennicy Orch OR odpowiadali, że wcześniejsze obliczenia opierały się na nieadekwatnych założeniach i że przy innych parametrach czasy mogą być dłuższe; spór jest stary i techniczny, a jego meritum dotyczy tego, czy realne struktury biologiczne mogłyby chronić koherencję dostatecznie długo.

Tyle że nawet gdyby kwantowe efekty w mózgu miały znaczenie, pozostaje pytanie, czy rozwiązuje to właściwy problem. Mechanika kwantowa może zmienić opis „jak działa urządzenie”, ale nie musi automatycznie wyjaśniać, skąd bierze się „jak to jest” – subiektywny smak doświadczenia.

Dlatego w głównym nurcie badań świadomość kwantowa bywa traktowana raczej jako hipoteza wysokiego ryzyka: fascynująca, ale niekonieczna do wyjaśniania większości danych neurobiologicznych.

Czy w końcu zrozumiemy świadomość?

Definitywne „zrozumienie świadomości” nie jest możliwe, bo świadomość nie jest jednym zjawiskiem. To paczka rzeczy naraz: poziom czuwania, treść doświadczenia, poczucie „ja”, ciągłość w czasie, możliwość kierowania uwagą i zdawania relacji. Najbardziej realistyczny scenariusz jest więc taki, że nauka będzie to po kolei rozdzielać i opisywać coraz precyzyjniej: które mechanizmy mózgowe odpowiadają za samą „obecność” doświadczenia, które za jego treść, a które tylko za raportowanie, język i kontrolę zachowania.

Największą zagadką pozostanie prawdopodobnie to, czy kiedykolwiek „domkniemy” różnicę między opisem mózgu a opisem przeżycia. Być może jednak nie musimy tego robić, by mówić o realnym zrozumieniu: wystarczy, że będziemy umieć wiarygodnie przewidywać, kiedy i dlaczego świadomość się pojawia, jak zmienia się jej treść, co ją wyłącza i co może ją przywrócić. Paradoksalnie to właśnie epoka AI może naukę popchnąć do przodu, bo wymusi ostre kryteria: jak odróżnić przeżywanie od samej symulacji zachowania i jak rozpoznać świadomość tam, gdzie nie da się o nią zapytać.

Biolog, dziennikarz popularnonaukowy, redaktor naukowy Międzynarodowego Centrum Badań Oka (ICTER). Autor blisko 10 000 tekstów popularnonaukowych w portalu Interia, ponad 50 publikacji w papierowych wydaniach magazynów „Focus", „Wiedza i Życie" i „Świat Wiedzy". Obecnie publikuje teksty na Focus.pl.

Biolog, dziennikarz popularnonaukowy, redaktor naukowy Międzynarodowego Centrum Badań Oka (ICTER). Autor blisko 10 000 tekstów popularnonaukowych w portalu Interia, ponad 50 publikacji w papierowych wydaniach magazynów „Focus", „Wiedza i Życie" i „Świat Wiedzy". Obecnie publikuje teksty na Focus.pl.

Komentarze